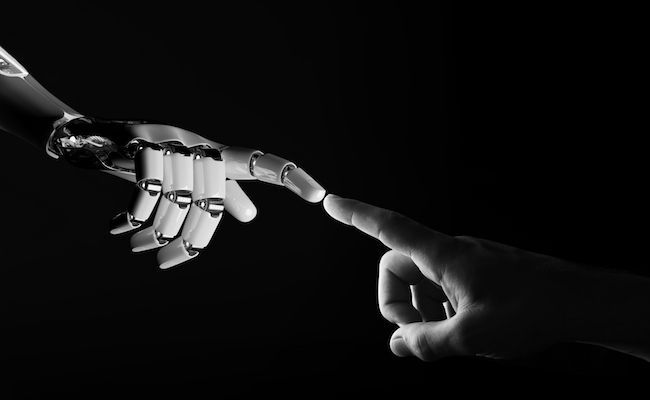

Etica dell’intelligenza artificiale

di Maria Chiara Volpi – CTS SEAC

“Artificial Intelligence is developing fast. It will change our lives by improving healthcare (e.g. making diagnosis more precise, enabling better prevention of diseases), increasing the efficiency of farming, contributing to climate change mitigation and adaptation, improving the efficiency of production systems through predictive maintenance, increasing the security of Europeans, and in many other ways that we can only begin to imagine. At the same time, Artificial Intelligence (AI) entails a number of potential risks, such as opaque decision-making, gender-based or other kinds of discrimination, intrusion in our private lives or being used for criminal purposes.”

Libro bianco sull’intelligenza artificiale, incipit

L’intelligenza artificiale (IA) è un ramo dell’informatica dedicato alla progettazione e alla programmazione di sistemi hardware e software che permettono di creare delle macchine con caratteristiche tipicamente umane quali, ad esempio, percezioni visive e spazio-temporali e capacità di apprendimento e decisionali. Si tratta di macchine pensanti (anche se non pensano veramente, limitandosi a simulare il ragionamento umano), decidono, imparano dagli errori e consentono di svolgere rapidamente funzioni che all’uomo richiederebbero molto tempo.

Scopri Law&HR

Abbonati

L’intelligenza artificiale offre molte opportunità in ambiti diversi della società, dai trasporti alla sanità, spaziando dagli assistenti virtuali alle tecniche di riconoscimento facciale e vocale, ma non devono essere sottovalutati i rischi per i diritti e le libertà fondamentali che derivano dallo sviluppo di questi sistemi. I risultati prodotti, che dovrebbero essere analoghi a quelli raggiunti da un umano con delle competenze specifiche, dipendono dalle regole di programmazione che vengono immesse nel sistema; si tratta di un processo che può essere influenzato intenzionalmente o meno.